L’intelligence artificielle (IA) est devenue omniprésente, mais combien d’entre nous comprennent réellement ses rouages ? Dites adieu aux explications pleines de jargon et retournez-vous vers le vif du sujet : comment l’IA apprend-elle et prend-elle des décisions ? En décomposant des concepts comme l’apprentissage automatique, les réseaux neuronaux et les algorithmes, nous allons explorer les fondements de cette technologie fascinante. Plus qu’un simple ensemble de règles, l’IA cherche à imiter des processus cognitifs humains en utilisant des données et des mathématiques. Mais les performances graphiques ne cachent-elles pas une complexité inquiétante ? Préparez-vous à plonger dans un monde où les chiffres règnent en maîtres et où la frontière entre l’intelligence humaine et artificielle se brouille.

Les bases de l’intelligence artificielle

L’intelligence artificielle (IA) est un domaine fascinant et en constante évolution, qui vise à créer des systèmes capables d’accomplir des tâches nécessitant généralement l’intelligence humaine. Pour mieux comprendre ce domaine complexe, il est essentiel d’explorer les bases de l’intelligence artificielle, qui comprennent sa définition, ses types et ses applications.

Définition de l’intelligence artificielle

L’intelligence artificielle se définit comme la capacité d’une machine à imiter des fonctions cognitives humaines telles que l’apprentissage, le raisonnement et la résolution de problèmes. Contrairement aux programmes informatiques traditionnels qui exécutent des instructions spécifiques, l’IA utilise des algorithmes sophistiqués pour apprendre des données et améliorer ses performances au fil du temps. Cette caractéristique d’apprentissage est souvent qualifiée de machine learning (apprentissage automatique), un sous-domaine de l’IA qui permet aux machines d’apprendre sans être explicitement programmées pour chaque tâche.

Types d’intelligence artificielle

Entre nous, on le sait bien, faire appel à un consultant en automatisation intelligente et en agent IA, c’est souvent le raccourci le plus malin. On en parle ?

Il existe principalement deux types d’intelligence artificielle :

- IA faible : Ce type d’IA est conçu pour accomplir des tâches spécifiques. Elle ne possède pas de véritable intelligence et se contente de suivre des instructions programmées. Un exemple classique d’IA faible est un assistant vocal comme Siri ou Alexa, qui peut répondre à des questions ou effectuer des commandes simples.

- IA forte : En revanche, l’IA forte, également connue sous le nom d’IA générale, est un concept théorique où la machine pourrait réaliser toute tâche intellectuelle qu’un humain peut effectuer. Cette forme d’IA aurait une capacité de compréhension et de raisonnement comparable à celle d’un être humain. Bien qu’il y ait des recherches dans ce domaine, l’IA forte n’a pas encore été réalisée.

Domaines d’application de l’intelligence artificielle

Les applications de l’IA sont vastes et en constante expansion. L’IA trouve des applications dans divers secteurs, y compris :

- La santé : L’IA est utilisée pour analyser des données médicales, diagnostiquer des maladies et personnaliser des traitements pour les patients.

- La finance : Les systèmes d’IA aident à détecter la fraude, à gérer des portefeuilles d’investissement et à offrir des recommandations financières personnalisées.

- Les transports : Les véhicules autonomes utilisent des algorithmes d’IA pour naviguer en toute sécurité et optimiser les trajets.

- Le service client : Les chatbots alimentés par l’IA fournissent un support client 24/7, améliorant l’expérience utilisateur tout en réduisant les coûts.

Ces exemples illustrent la polyvalence de l’IA et son potentiel pour transformer de nombreux aspects de notre vie quotidienne. Pour en savoir plus sur les bases de l’intelligence artificielle et mieux comprendre ce domaine, vous pouvez consulter cet article ici.

L’apprentissage automatique

L’intelligence artificielle repose en grande partie sur le concept d’apprentissage automatique, qui permet aux machines de tirer des conclusions et d’effectuer des prédictions à partir de données. Il existe plusieurs techniques d’apprentissage automatique, chacune ayant ses propres méthodes et applications.

L’apprentissage supervisé est l’une des techniques les plus couramment utilisées. Dans ce cadre, un modèle est entraîné sur un ensemble de données d’apprentissage qui contient des entrées et leurs sorties correspondantes. L’objectif ici est d’apprendre une fonction qui peut prédire la sortie d’une nouvelle entrée. Par exemple, on peut entraîner un modèle à reconnaître des images de chiens et de chats. Grâce à des milliers d’exemples annotés, le modèle apprend à distinguer les caractéristiques des deux catégories. Ce type d’apprentissage est particulièrement efficace pour des tâches telles que la classification et la régression.

D’un autre côté, l’apprentissage non supervisé ne nécessite pas d’étiquetage des données. Au lieu de cela, il tente de découvrir des motifs ou des structures sous-jacentes dans les données brutes. Une méthode fréquemment employée dans ce contexte est le clustering, où les algorithmes regroupent des données similaires ensemble. Par exemple, l’analyse des clients sur la base de leurs comportements d’achat dans un supermarché pourrait conduire à la création de segments de marché, sans avoir à définir ces segments au préalable. Cette technique est essentielle pour des applications comme la segmentation de marché, l’analyse des données, et bien plus encore.

Une autre technique pertinente est l’apprentissage par renforcement, qui se distingue par son approche unique. Dans ce cas, un agent interactue avec un environnement et apprend à travers des essais et des erreurs. Plutôt que d’être guidé par des étiquettes, l’agent reçoit des récompenses ou des pénalités en fonction de ses actions. Ce type d’apprentissage est souvent utilisé dans le développement de jeux vidéo ou dans la robotique, où un agent apprenant à naviguer dans un environnement complexe doit optimiser ses actions pour maximiser ses récompenses. Par exemple, les algorithmes d’apprentissage par renforcement ont été employés pour développer des personnages de jeux capables de jouer contre des humains à un niveau très compétitif.

Chacune de ces techniques d’apprentissage automatique présente des avantages et des inconvénients. Le choix de la méthode dépendra largement du type de données disponibles et des objectifs spécifiques du projet. S’une de ces méthodes pourrait paraître plus adaptée à une situation donnée, il est souvent avantageux d’explorer les autres techniques d’apprentissage automatique pour déterminer laquelle révélera le meilleur rendement. Les opportunités offertes par l’apprentissage automatique sont vastes et en constante évolution, propulsant l’IA vers de nouvelles frontières. Pour approfondir ce sujet, vous pouvez consulter cet article sur l’apprentissage automatique.

Les réseaux neuronaux

Les réseaux neuronaux constituent l’un des éléments clés de l’intelligence artificielle, reflétant de manière élégante le fonctionnement du cerveau humain. Leur structure est composée de neurones artificiels, organisés en couches. Ces couches incluent la couche d’entrée, la ou les couches cachées et la couche de sortie. Chaque neurone dans la couche d’entrée reçoit un ensemble de données d’entrée, qu’il traite puis transmet à la couche suivante. Ce traitement est réalisé via des fonctions d’activation qui déterminent si un neurone doit « s’activer » ou non.

La connexion entre les neurones est régie par des poids, qui sont ajustés durant le processus d’apprentissage. Au début, ces poids sont souvent initialisés de manière aléatoire. Lorsqu’un réseau neuronal reçoit des données, il effectue une prédiction en faisant passer les informations du neurone d’entrée à la couche cachée, puis à la couche de sortie. À ce stade, la prédiction effectuée est comparée à la sortie attendue, permettant de calculer une erreur. Cette erreur est ensuite rétropropagée à travers le réseau pour ajuster les poids et améliorer la précision des prédictions.

Les réseaux neuronaux sont efficaces car ils peuvent capturer des relations complexes dans les données. Grâce à la profondeur des couches cachées, un réseau peut apprendre des représentations hiérarchiques. Par exemple, dans le cas de l’analyse d’images, les premières couches peuvent apprendre à détecter des bords, tandis que les couches plus profondes peuvent reconnaître des formes et, finalement, des objets entiers. Cela leur confère la capacité de traiter des données non structurées, comme des images, des sons ou du texte.

Il existe différents types de réseaux neuronaux, chacun adapté à des tâches spécifiques. Les réseaux de neurones convolutifs (CNN) sont particulièrement efficaces pour le traitement d’images, tandis que les réseaux de neurones récurrents (RNN) excellent dans le traitement des données séquentielles, comme le texte ou la parole. Ces variations reposent sur l’architecture du réseau et les fonctions d’activation utilisées.

La montée en puissance des réseaux neuronaux a été catalysée par l’augmentation des capacités de calcul et la disponibilité de grandes quantités de données. Aujourd’hui, ces réseaux sont à la base des technologies innovantes, telles que la vision par ordinateur, la traduction automatique et la génération de langage naturel. En d’autres termes, les avancées en IA que nous constatons aujourd’hui auraient été impossibles sans l’utilisation de réseaux neuronaux. Les progrès réalisés dans ce domaine ouvrent la voie à une multitude d’applications et de révolutions technologiques à venir.

Pour une exploration plus approfondie des réseaux neuronaux, vous pouvez consulter le lien suivant : Références sur les réseaux de neurones artificiels.

Les algorithmes au cœur de l’IA

Les algorithmes sont au cœur de l’intelligence artificielle, agissant comme les moteurs qui propulsent le traitement des données et la prise de décision. Ils constituent des ensembles de règles et de processus permettant aux machines d’apprendre à partir des données, d’identifier des modèles, et de faire des prévisions. Voici un aperçu des algorithmes courants utilisés en IA, ainsi que de leurs rôles fondamentaux.

- Algorithmes d’apprentissage supervisé : Ces algorithmes apprennent à partir d’un ensemble de données étiquetées. Parmi les techniques les plus populaires figurent les régressions, arbres de décision, et réseaux de neurones. Par exemple, la régression linéaire prédit une valeur continue, tandis que les arbres de décision sont utilisés pour des classifications. Ces algorithmes sont cruciaux dans des applications telles que la classification d’images ou la prédiction de comportement des consommateurs.

- Algorithmes d’apprentissage non supervisé : Contrairement aux algorithmes supervisés, ces algorithmes traitent des données non étiquetées pour découvrir des structures sous-jacentes. Parmi les méthodes d’apprentissage non supervisé, on trouve le clustering et l’analyse en composantes principales (ACP). Le clustering permet de regrouper des données similaires, utile dans la segmentation de marché. L’ACP, quant à elle, aide à réduire la dimensionnalité des données tout en conservant les caractéristiques importantes.

- Algorithmes d’apprentissage par renforcement : Ces algorithmes apprennent à travers l’interaction avec leur environnement en maximisant une notion de récompense. Des techniques comme les méthodes Q et les réseaux de neurones profonds sont souvent utilisées. Par exemple, un agent peut apprendre à jouer à un jeu en essayant différentes stratégies et en recevant des récompenses ou des pénalités. Cela lui permet d’optimiser son comportement sur la base de l’expérience accumulée.

Chaque algorithme joue un rôle spécifique dans le cycle de traitement des données. Dans le cadre de l’apprentissage supervisé, les données sont prétraitées et normalisées, puis l’algorithme est entraîné sur un sous-ensemble de ces données. Après formation, l’algorithme peut faire des prédictions sur des données inconnues, évaluant ainsi sa performance sur un ensemble de test. Pour l’apprentissage non supervisé, l’algorithme analyse directement les données pour identifier des groupes ou des structures, sans intervention humaine pour guider le processus.

L’utilisation d’algorithmes d’apprentissage par renforcement ouvre la voie à des applications beaucoup plus dynamiques dans les environnements en constante évolution, comme les jeux vidéo ou la robotique. Ces algorithmes permettent à la machine de s’adapter et d’améliorer ses performances grâce à l’expérimentation et à l’analyse des résultats.

Il est également important de noter que la sélection d’un algorithme approprié dépend fortement de la nature du problème à résoudre, des données disponibles et des spécificités des résultats souhaités. Pour une exploration plus poussée des mécanismes derrière ces algorithmes et leur mise en œuvre dans des contextes variés, des ouvrages tels que « Au cœur de l’intelligence artificielle » peuvent fournir des éclairages précieux. En somme, la maîtrise de ces algorithmes est essentielle pour tirer le meilleur parti des avancées en intelligence artificielle, tout en continuant à affiner et à étendre les capacités des systèmes intelligents.

Les défis et les limites de l’IA

L’intelligence artificielle (IA) fait face à divers défis, tant sur le plan technique qu’éthique. Tout d’abord, sur le plan technique, l’un des principaux obstacles réside dans l’accès et la qualité des données. Les algorithmes d’IA, en particulier ceux qui reposent sur l’apprentissage automatique, nécessitent de grandes quantités de données annotées pour s’entraîner efficacement. Si les données sont incomplètes, biaisées ou de mauvaise qualité, cela peut conduire à des résultats inexacts et à des systèmes d’IA non fiables.

- Le biais algorithmique : L’un des problèmes les plus préoccupants est la présence de biais dans les jeux de données d’entraînement. Si les données utilisées pour former un modèle d’IA reflètent des préjugés sociétaux ou culturels, l’IA risque de reproduire ces biais, ce qui peut avoir des conséquences graves, notamment en matière de discrimination.

- La transparence et l’explicabilité : De nombreux modèles d’IA, en particulier les réseaux de neurones profonds, sont souvent considérés comme des « boîtes noires ». Cela signifie qu’il est difficile de comprendre comment ces modèles prennent des décisions. Cette opacité pose des défis en matière de confiance et d’acceptabilité sociale, car les utilisateurs et les décideurs peuvent être réticents à adopter des systèmes dont ils ne comprennent pas le fonctionnement.

- La durabilité : De plus, le développement et le déploiement d’IA nécessitent une grande puissance de calcul, ce qui soulève des préoccupations concernant l’impact environnemental. Les ressources énergétiques nécessaires pour former de grands modèles peuvent être considérables, et la question de la durabilité de ces pratiques devient de plus en plus cruciale.

Sur le plan éthique, l’IA soulève également des questions importantes. L’une des préoccupations majeures est la protection de la vie privée. Alors que l’IA repose sur l’analyse de grandes quantités de données, souvent personnelles, il existe un risque élevé d’atteinte à la vie privée des individus. Les entreprises et les gouvernements doivent naviguer entre l’innovation technologique et le respect des droits individuels, ce qui peut être un exercice délicat.

Un autre défi éthique réside dans l’automatisation et son impact sur l’emploi. Alors que l’IA peut améliorer l’efficacité et réduire les coûts, elle peut également conduire à la disparition de certains emplois, suscitant des préoccupations quant à l’avenir du travail. Les sociétés doivent s’interroger sur la manière dont elles peuvent accompagner cette transition afin de minimiser les répercussions négatives sur l’emploi.

En somme, l’IA, bien qu’elle offre un potentiel fascinant et des opportunités révolutionnaires, doit être abordée avec précaution. Les défis techniques et éthiques auxquels elle est confrontée nous rappellent l’importance d’une réflexion critique sur son développement et son utilisation. Pour en savoir plus sur les enjeux de l’intelligence artificielle, consultez cet article sur la définition, les usages et les enjeux de l’IA. Il est essentiel que les acteurs concernés, des entreprises aux gouvernements, collaborent pour garantir que l’adoption de l’IA soit bénéfique et éthique pour la société dans son ensemble.

L’avenir de l’intelligence artificielle

L’avenir de l’intelligence artificielle soulève de nombreuses réflexions quant à son développement et ses implications pour la société. À mesure que l’IA continue d’évoluer, ses applications s’étendent à divers secteurs, influençant la manière dont nous travaillons, apprenons et interagissons. Les avancées technologiques, telles que le machine learning et les réseaux de neurones, offrent des possibilités inimaginables qui pourraient transformer notre quotidien.

L’un des aspects les plus remarquables de la progression de l’IA est son potentiel à améliorer l’efficacité des processus dans les entreprises. Par exemple, des systèmes intelligents peuvent analyser d’énormes quantités de données pour dégager des tendances et des informations précieuses, permettant aux entreprises de prendre des décisions éclairées. Cependant, cela soulève également des préoccupations éthiques. La question de la responsabilité en matière de décisions automatisées se pose, surtout lorsque ces décisions peuvent avoir un impact direct sur des vies humaines.

Les implications de l’IA s’étendent également au marché du travail. L’automatisation alimentée par l’intelligence artificielle pourrait entraîner la disparition de certains emplois, en particulier ceux qui sont répétitifs ou routiniers. Cependant, il est aussi anticipé que de nouveaux rôles émergeront, nécessitant des compétences liées à la technologie, à l’analyse de données ou à la gestion des systèmes intelligents. D’où la nécessité pour le système éducatif de s’adapter en intégrant des programmes de formation centrés sur ces compétences du futur.

En parallèle, l’IA pourrait jouer un rôle clé dans des enjeux mondiaux tels que la santé et l’environnement. Par exemple, des algorithmes avancés peuvent aider à diagnostiquer des maladies de manière précoce ou à optimiser les ressources naturelles, contribuant ainsi à une gestion durable de notre planète. L’utilisation de l’IA pour des prévisions climatiques plus précises pourrait être essentielle dans notre lutte contre les changements climatiques.

Malgré ces opportunités, il est crucial de prendre en compte les défis éthiques et techniques que cela implique. La demande croissante pour une transparence dans les algorithmes et une régulation des technologies d’IA devient pressante. La question de la protection des données personnelles et de la vie privée est devenue centrale dans ce débat, d’autant plus que des systèmes de surveillance intelligents se généraliseront.

La diversité dans le développement de l’IA est également essentielle pour s’assurer que ces technologies servent un large éventail de perspectives humaines. Les biais dans les algorithmes peuvent conduire à des discriminations, ce qui souligne l’importance d’une conception inclusive.

En somme, l’avenir de l’intelligence artificielle est aussi prometteur que complexe. Les impacts de cette technologie sur nos sociétés dépendront de la façon dont nous choisissons de l’orienter, tant au niveau des décisions politiques que des approches éthiques. Il est essentiel d’engager une discussion collective sur ces questions, afin d’anticiper les conséquences possibles et orienter le développement de l’IA vers un avenir qui profite à tous. Pour explorer davantage ces enjeux, vous pouvez consulter des ressources comme ce lien qui offre une vision détaillée de l’avenir de l’intelligence artificielle en 2023.

Conclusion

L’intelligence artificielle, loin d’être un simple phénomène futuriste, est déjà ici, ancrée dans nos vies quotidiennes et nos entreprises. Notre exploration, des bases théoriques aux défis éthiques, nous démontre que l’IA est un outil puissant mais délicat à manier. Les applications sont vastes, de la reconnaissance vocale aux recommandations de films, mais cette polyvalence s’accompagne de préoccupations légitimes. L’apprentissage automatique et les réseaux neuronaux, bien que fascinants, doivent être utilisés avec prudence. Nous avons frôlé la ligne qui sépare l’intelligence humaine de l’intelligence artificielle. Les algorithmes, bien qu’ingénieux, sont aussi marqués par des biais et des flous. Alors que nous avançons, il est essentiel de naviguer prudemment sur ce chemin pavé d’obsidienne technologique, conscient que chaque progrès doit s’accompagner d’une réflexion éthique. L’avenir de l’IA dépend de notre capacité à l’utiliser à bon escient. Si nous voulons qu’elle améliore nos vies, nous devons aussi être prêts à en discuter, à évaluer ses implications et à poser des questions qui peuvent sembler dérangeantes. L’IA ne doit pas devenir une fin en soi, mais plutôt un outil au service d’une humanité mieux informée et plus empathique.

FAQ

Qu’est-ce que l’intelligence artificielle exactement ?

Réponse : L’IA désigne des systèmes informatiques capables d’effectuer des tâches qui requièrent une intelligence humaine, comme la reconnaissance vocale, la prise de décision et l’apprentissage de nouvelles informations.

Quelles sont les différences entre l’apprentissage supervisé et non supervisé ?

Réponse : L’apprentissage supervisé utilise des données étiquetées pour entraîner un modèle, alors que l’apprentissage non supervisé exploite des données non étiquetées pour identifier des motifs cachés.

Pourquoi les réseaux neuronaux sont-ils importants ?

Réponse : Les réseaux neuronaux imitent le fonctionnement du cerveau humain et sont essentiels à des avancées significatives dans le traitement du langage naturel, la vision par ordinateur et d’autres domaines.

Quels sont les principaux défis de l’IA ?

Réponse : Les défis incluent des biais algorithmiques, des préoccupations sur la vie privée et la sécurité, ainsi que des questions éthiques sur l’automatisation et l’autonomie des systèmes.

Quel est l’avenir de l’intelligence artificielle ?

Réponse : L’avenir de l’IA est prometteur, mais il soulève des questions cruciales sur la régulation, l’impact sur l’emploi et les implications sociales. Un dialogue continu est nécessaire pour guider son développement.

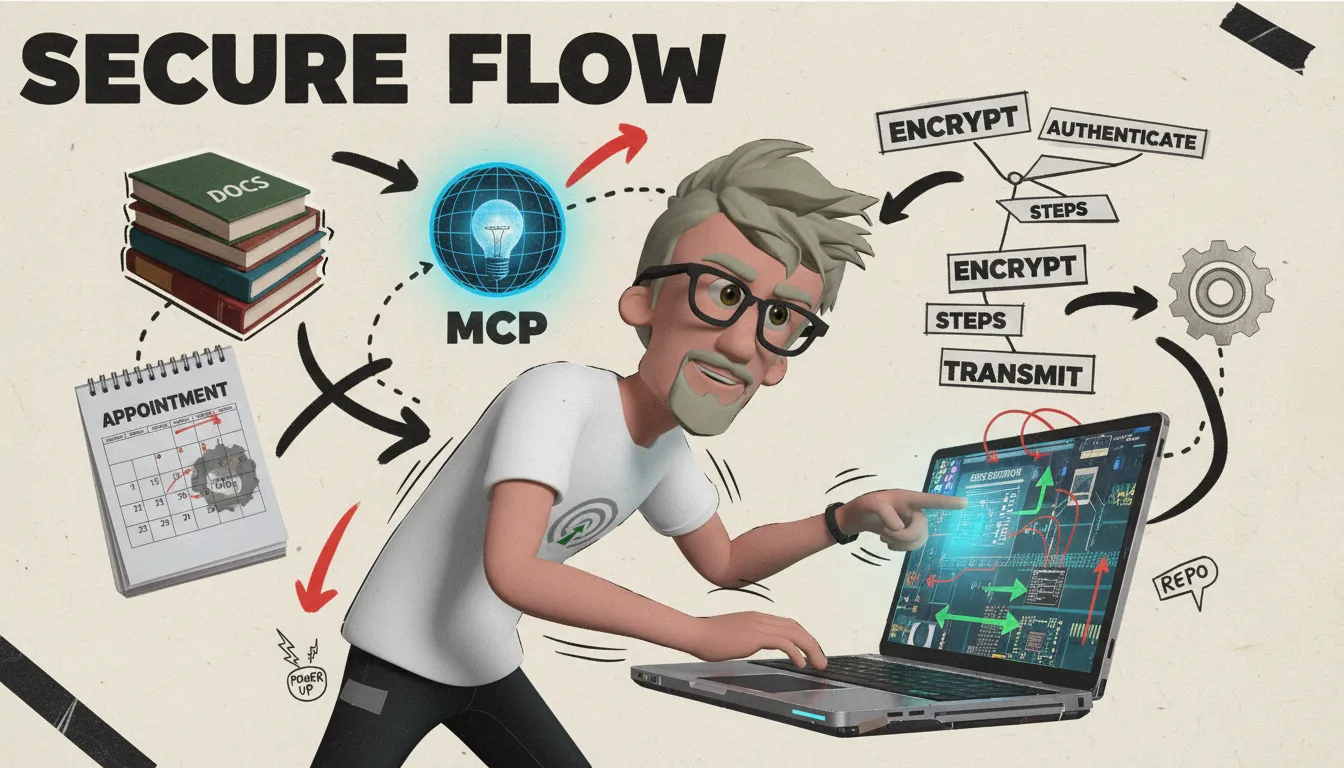

⭐ Data Analyst, Analytics Engineer et expert dans l’automatisation IA ⭐

Ref clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Football Français, Texdecor…

Mon terrain de jeu :

Data Analyst & Analytics engineering : tracking propre RGPD, entrepôt de données (GTM server, BigQuery…), modèles (dbt/Dataform), dashboards décisionnels (Looker, SQL, Python).

Automatisation IA des taches Data, Marketing, RH, compta etc : conception de workflows intelligents robustes (n8n, Make, App Script, scraping) connectés aux API de vos outils et LLM (OpenAI, Mistral, Claude…).

Engineering IA pour créer des applications et agent IA sur mesure : intégration de LLM (OpenAI, Mistral…), RAG, assistants métier, génération de documents complexes, APIs, backends Node.js/Python.